In Huxley’s vision, no Big Brother is required to deprive people of their autonomy, maturity and history. As he saw it, people will come to love their oppression, to adore the technologies that undo their capacities to think.

(Amusing Ourselves to Death, p. xix)

Wanneer we het over AI assistenten hebben, geven we vaak de waarschuwing dat we ons denken niet moeten uitbesteden aan een taalmodel. We moeten zelf kritisch blijven denken en de ideeën van AI ter overweging nemen. Echter, onderzoekers van Google Deepmind waarschuwen voor een nog sluwer risico: taalkundige homogenisering, oftewel, een verarming en vervorming van niet alleen onze stem maar ook onze mening. Hoe meer we AI gebruiken voor ons schrijven, hoe meer we bewegen naar een grijs gemiddelde. Het is alsof je alleen nog maar eet via het gemak van een magnetron en daardoor langzaam het koken in de keuken vergeet. Ja, we hebben sneller eten op tafel maar leveren in op smaak, variatie, en voedzaamheid.

How LLMs Distort Our Written Language

In het onderzoek van onder andere Google Deepmind “How LLMs Distort Our Written Language” komt naar voren dat het gebruik Large Language Models (LLMs; de technologie achter diensten zoals Claude, ChatGPT, en Gemini) niet alleen de schrijfstijl en de toon van menselijke schrijven verandert maar ook de bedoelde betekenis van een tekst. Een LLM gaat verder dan een tekst ‘verbeteren’, het kaapt de intentie en de stem van de schrijver. Het blijkt dat LLM’s ook de neiging hebben om verder te gaan dan slechts grammaticale wijzigingen aan te brengen en naar een neutraal midden bewegen: “Deze bevindingen wijzen op een discrepantie tussen het vermeende voordeel van het gebruik van AI en een impliciet, consistent effect op de semantiek van menselijk schrijven.”

Taalkundige homogenisering

Al in eerdere onderzoeken waren er zorgen geuit over ’taalkundige homogenisering’, oftewel dat LLM’s veel dezelfde bewoordingen en structuren gebruiken: “LLM’s hebben de neiging om griezelig opvallend vergelijkbare antwoorden te geven op open vragen.” Het veelvuldig gebruik van LLM’s in het schrijfproces zorgt daardoor voor minder diverse teksten. Daarnaast gaan mensen, omdat ze steeds meer Generatieve AI gebruiken LLM taalpatronen overnemen in hun eigen geschreven teksten, zelfs in gesproken taal.

LLM’s zorgen voor een hogere productiviteit, maar aan de andere kant zorgt het gebruik voor ook minder creatieve en diverse teksten. Deelnemers aan het onderzoek die zwaar leunden op het gebruik van een LLM bij het schrijven van hun essay vonden hun essay minder creatief en minder in hun schrijfstijl, maar ze waren net zo tevreden over het eindresultaat als deelnemers die geen LLM hadden gebruikt.

Meningsvervorming

Deze taalkundige homogenisering gaat verder dan alleen stilistische veranderingen. De onderzoekers maken zich zorgen dat al bij een simpele grammatica controle, de LLM’s veelvuldig de conclusie van een essay aanpasten. LLM’s corrigeren niet simpelweg fouten of verbeteren de helderheid van een tekst, maar vervormen de inhoud van essays fundamenteel naar een zelfde semantische stijl. Dit is niet vreemd, de onderzoekers zeggen dan ook: “LLM’s hebben geen intrinsieke prikkel of mechanisme om de bedoelde betekenis van de gebruiker te behouden.” Met andere woorden, de LLM kijkt alleen naar woordgebruik, niet naar intentie. Een LLM begrijpt niet. Het berekent de kans op een volgend woord ten opzichte van eerder gebruikte woorden.

Wanneer een LLM veel werd gebruikt in het schrijfproces, was de tekst significant anders dan dat als hij geschreven zou worden door mensen. Beginnende, onzekere schrijvers nemen de inhoud van de LLM vaak over. Hierdoor zullen LLM’s steeds meer menselijke communicatie vormen en beslissingen beïnvloeden. Wanneer LLM’s op grote schaal worden ingezet, vernauwd dat onze communicatie. We bewegen naar een nietszeggend neutraal midden.

Functioneel gebruik

Echter, niet al het LLM gebruik resulteerde in een vervorming van de menselijke tekst. Als studenten al vertrouwen hadden in hun schrijfvaardigheid en voorkennis over schrijven, kon de AI hulp kritischer worden gebruikt. Wanneer de LLM slechts beperkt werd gebruikt en als zoekinstrument, behield de tekst de semantische betekenis, creativiteit, en de eigen stem.

Conclusie van het onderzoek

Het gebruik van AI in het schrijfproces geeft een hoog risico op verandering van de schrijfstijl, de toon, en zelfs de inhoud, ook als het slechts voor grammatica controle wordt gebruikt. Dit is logisch. AI modellen verwerken tekst, maar begrijpen geen inhoud. Ze geven een gewogen gemiddelde van wat er in hun dataset stond. De onderzoekers geven dan ook de noodzaak aan algoritmes zo te ontwerpen dat ze de intentie van de schrijver beter kunnen inschatten en daardoor binnen die intentie blijven.

Data degeneratie

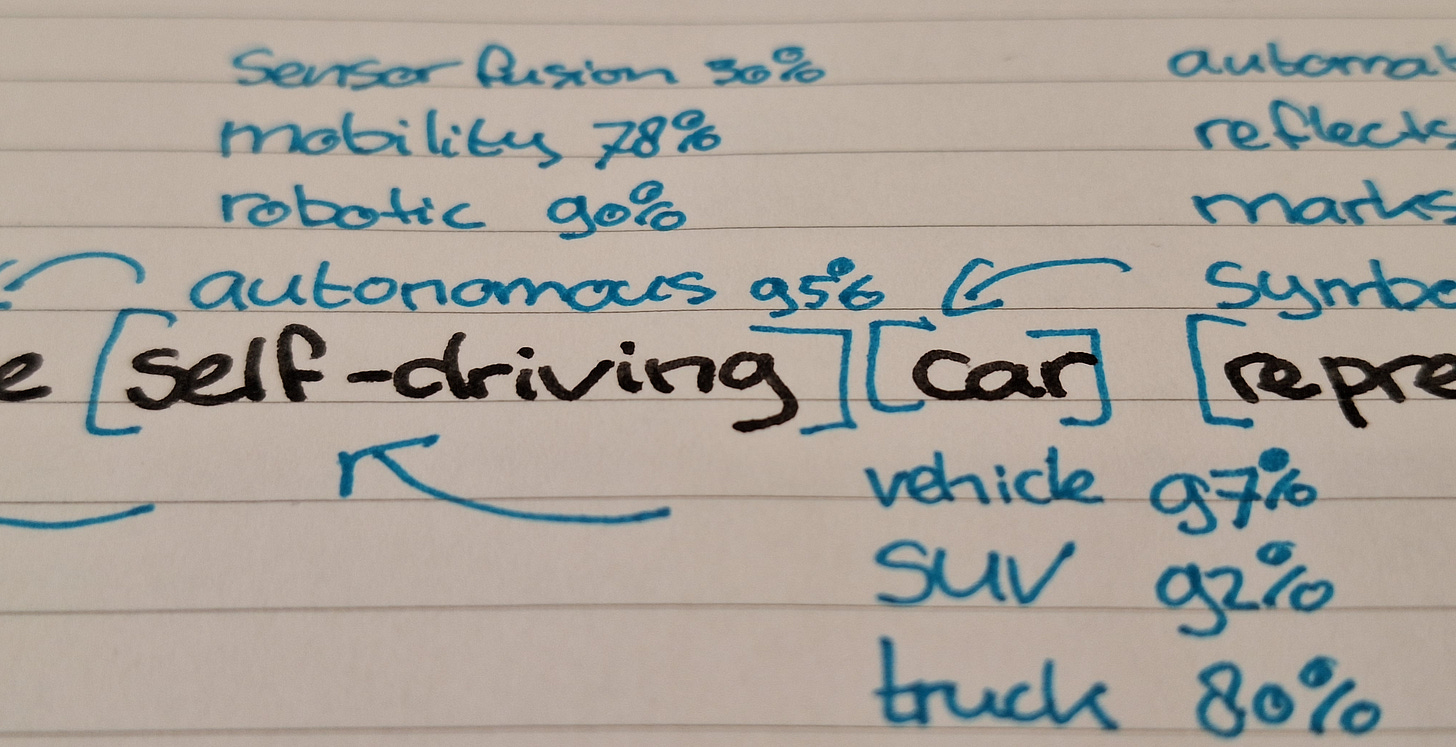

Veel mensen denken bij risico’s van AI als schrijfhulp aan cognitieve uitbesteding (R3:C4): niet zelf meer nadenken, maar de AI het voor je laten doen. De oplossing zou dan liggen in een AI die meer vragen stelt en constructieve feedback geeft. Het risico dat de onderzoekers van Deepmind hier echter laten zien, is van een andere orde. LLM’s hebben de voorkeur voor een taalkundige homogenisering, zowel op vorm als op inhoud (R3:T6). De communicatie van een LLM, hoe het taal gebruikt, is ook een probleem. Redigeren, feedback, suggesties, herschrijvingen, het neigt uiteindelijk allemaal naar een grijs gemiddelde.

Dit is niet nieuw. Het is al vrij lang bekend dat als je nieuwe modellen traint op synthetische data, data gegenereerd door andere LLM’s, het nieuwe model kan laten imploderen. Synthetische data getraind op synthetische data degenereert namelijk. De taal wordt minder rijk, de meningen magerder, en bepaalde vooroordelen dominant. Veelvuldig gebruik van een LLM voor het schrijfproces zal dan ook eenzelfde effect hebben op de schrijfontwikkeling van een leerling of student.

Het internet raakt ook steeds meer vervuild met synthetische data. In 2025 overstijgen AI gegenereerde teksten al menselijke teksten en de voorspelling is dat in 2030 de meeste data synthetisch zal zijn. Dit gaat een probleem worden voor de ontwikkeling van nieuwe modellen, maar dit betekent ook dat de mens steeds meer povere, algemene, neutrale teksten leest en genereert.

Het probleem van schrijven

Schrijven is moeilijk. Het zelf onder woorden kunnen brengen wat je nu precies denkt, binnen de grammaticale regels van je taal vraagt veel cognitieve inspanning. Daniel Kahneman stelde in Thinking Fast and Slow dat mensen van nature lui zijn. Dit is logisch. Het lichaam, en ook de geest, besparen het liefst energie om, wanneer het er echt toe doet, er voldoende is om te gebruiken. Wanneer een LLM ons een tekst voorschotelt of adviezen geeft over onze schrijfvaardigheid, hebben wij de neiging om dat voor ‘waar’ of in ieder geval voor ‘goed genoeg’ aan te nemen. Niet alleen omdat wij denken het niet beter te kunnen, maar simpelweg ook om cognitieve inspanning te vermijden.

Daarbovenop komt nog het fenomeen van ‘automatiseringsbias‘. Mensen hebben de neiging om de output van technologie meer te vertrouwen dan dat ze dat zouden moeten. Technologie voelt als accuraat en objectief waardoor we het sneller voor waar aannemen, zeker als we voor een langere periode met die technologie werken.

Voor veel AI gebruikers gaat het uiteindelijk niet om het beter worden in schrijven of zelfs hun mening. Tekst wordt nog wel eens gebruikt, ook volgens de Deepmind onderzoekers, als ‘carrière boost’. Het gaat er niet om wat er gezegd wordt, maar dat er iets gezegd wordt. Dit fenomeen zie je veel op LinkedIn. Mensen laten AI hun teksten schrijven, aanpassen, of redigeren omdat ze het zelf schrijven niet alleen moeilijker vinden en ze zich misschien onzeker voelen over hun eigen schrijven, maar ook omdat zelf schrijven minder productief is. Daarnaast is social media zo ontworpen dat het kwantiteit beloont over kwaliteit.

Schrijfonderwijs

AI als schrijfhulp heeft risico. Op elke niveau zal het model een neiging hebben het schrijfwerk naar een neutraal midden te dirigeren (te synthetiseren). Als beginneling (‘novice’ volgens de onderzoekers) ben je nog niet in staat de feedback van AI op waarde in te schatten. Zorgt een AI schrijfassistent ervoor dat je betere essays gaat schrijven, of dat je beter synthetische essays gaat schrijven: afgestompt, afgevlakt, en geneutraliseerd?

Schrijfvaardigheid in het funderend onderwijs is hierdoor nog belangrijker dan ooit. Je moet in staat kunnen zijn synthetische teksten kritisch te beoordelen op waarde. Als je niet weet hoe je zelf iets onder woorden kunt brengen en altijd leunt op AI suggesties, zal je eigen taalgebruik poverder worden. Als je les hebt gehad met behulp van een AI schrijfassistent, zal je taalgebruik zich steeds meer vormen naar het synthetische, grijze gemiddelde. Daarnaast ontwikkel je ook niet je eigen stijl en je eigen verwoordingen. Dit zal effect hebben op je identiteitsvorming. Alleen gevorderde schrijvers zullen in staat zijn AI te gebruiken als informatiebron en hun eigen stem weten te behouden.

Dit vraagt om intensiever schrijfonderwijs met rijke schrijfopdrachten zonder AI. Leerlingen moeten meer vertrouwen krijgen in hun eigen schrijven zodat ze later AI suggesties beter kunnen beoordelen. Daarnaast moet er ook meer ruimte komen in het funderend onderwijs om te experimenteren met het vinden van een eigen stijl. Creatieve schrijfopdrachten kunnen hier een waardevolle bijdrage aan leveren en het is goed dat deze meer aandacht krijgen in de nieuwe eindtermen.

De AI staat, ondanks de snelle ontwikkelingen, nog steeds in haar kinderschoenen. We moeten niet vergeten dat kinderen en jongeren in het funderend onderwijs nog in ontwikkeling zijn en AI anders benaderen, met minder bagage, dan volwassenen. Zij moeten nog hun domeinkennis opbouwen. Die domeinkennis moet rijk zijn in authentieke taal en zij moeten ook rijke, menselijke teksten kunnen produceren met menselijke feedback en suggesties. Door te leunen op LLM’s en AI schrijfassistenten beperken we steeds meer ons eigen denken. Het risico is dan ook niet alleen dat AI gedachten verwoordt, maar ook dat AI gedachten verwoordt.